I modelli di intelligenza artificiale che selezionano i bersagli militari e guidano droni e missili, le aziende tecnologiche che diventano fornitori di sistemi d’arma, i bilanci della difesa che crescono mentre quelli della ricerca civile calano. Il nuovo OECD Science, Technology and Innovation Outlook 2025 aveva cominciato a descrivere questi segnali nell’ec0nomia della ricerca s sviluppo globale. Negli ultimi giorni queste tendenze sono all’opera nel nuovo teatro di guerra mediorientale. Come sottolinea anche il libro di Dario Guarascio Imperialismo digitale (recensito qui), il mondo delle armi non poteva ignorare lo straordinario contributo di intelligenza portato dai nuovi LLM.

Quando l’IA sceglie i bersagli

Di solito gli uffici di marketing vendono l’innovazione parlando delle medicina di precisione che salva i bambini da terribili malattie, ma la realtà si incarica poi di mostrare le scuole sbriciolate dall’ennesimo missile che ha sbagliato bersaglio di pochi metri. Un caso emblematico di questi giorni è quello di Anthropic. L’azienda californiana che ha sviluppato il modello Claude — già integrato da Palantir nelle reti “classified” del Pentagono e usato dai comandi militari per analisi di intelligence e selezione dei bersagli — si è trovata al centro di uno scontro senza precedenti con l’amministrazione Trump. Il segretario alla difesa Pete Hegseth ha posto un ultimatum: rimuovere i guardrail etici che impediscono al modello di essere usato per sistemi d’arma autonomi e sorveglianza di massa dei cittadini americani, o perdere il contratto da 200 milioni di dollari ed essere designata come “rischio per la supply chain della sicurezza nazionale” — una misura mai applicata prima a un’impresa americana. Il CEO Dario Amodei ha rifiutato, dichiarando di non poter in buona coscienza acconsentire, e che dissentire dal governo «è la cosa più americana del mondo». La risposta è stata immediata: Trump ha ordinato a tutti gli enti federali di cessare l’uso di prodotti Anthropic. OpenAI ha firmato un accordo con il Pentagono la stessa sera, affermando di mantenere gli stessi principi etici che Anthropic non aveva voluto abbandonare — un cortocircuito che anche il CEO Sam Altman ha definito un precedente «estremamente preoccupante».

Il paradosso è che poche ore dopo la scomunica presidenziale Claude era operativo durante i bombardamenti sull’Iran. L’integrazione dei modelli di IA nelle infrastrutture operative militari è già così profonda da non poter essere smontata nemmeno per ordine del Presidente degli Stati Uniti. Si può anche fare il beau geste di invocare l’etica, ma ormai ci sei dentro fino al collo, e l’unica etica possibile è quella di rendere l’opera di distruzione e disarmo del nemico la più rapida ed efficiente possibile.

C’è poco da fare, anche la ricerca è stata arruolata dai comandi militari, oltre che per scopi di sorveglianza civile anche in paesi un tempo democratici come gli Stati Uniti. Nel luglio 2025 il Dipartimento della Difesa americano ha assegnato contratti individuali fino a 200 milioni di dollari a Anthropic, OpenAI, Google e xAI per l’accesso ai loro modelli su reti governative classificate. Scale AI ha sviluppato il “Defense Llama”, un LLM ottimizzato per utenti militari, basato su Llama 3 di Meta. Palantir di Peter Thiel ha integrato Claude di Anthropic nelle reti del Pentagono per analisi di intelligence e supporto decisionale in tempo reale. In pochi anni, la Silicon Valley è diventata insomma la principale fornitrice di capacità cognitiva all’apparato militare americano. Come documenta l’OCSE nel suo Outlook Science and Technology 2025, le prime cento aziende mondiali coprono già il 50% della R&S privata globale: nell’IA di frontiera questa concentrazione è ancora più estrema, e le scelte tecnologiche ed etiche dei principali sviluppatori diventano di fatto scelte di politica pubblica, senza che nessun parlamento le abbia deliberate.

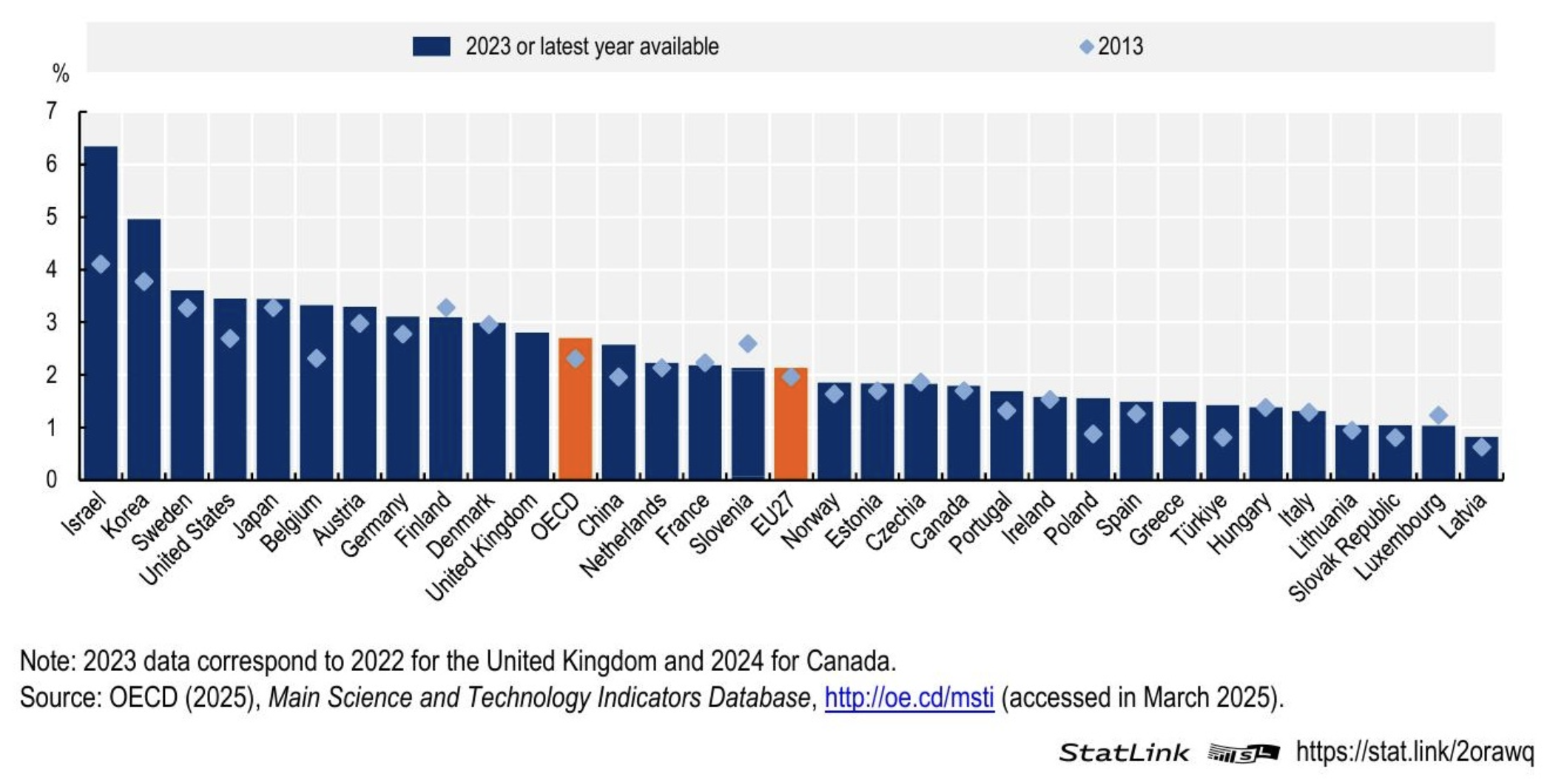

Figura 1 — Intensità di R&S in percentuale del PIL, paesi selezionati, 2013 e 2023. Le barre arancioni evidenziano la media OCSE e l’UE27. Fonte: OCSE (2025), Main Science and Technology Indicators Database.

La torsione securitaria della ricerca

A ben vedere ricerca civile e militare spesso rimandano una all’altra, ma non nel senso di un trasferimento virtuoso di risorse dalla sfera militare a quella civile, come vuole lo stantio apologo della nascita di internet dal DARPA. Oggi accade il contrario. Secondo il SIPRI, la spesa militare globale ha raggiunto i 2.718 miliardi di dollari nel 2024 — una crescita del 9,4% in termini reali, il tasso più alto dagli anni della Guerra Fredda — mentre i bilanci pubblici per la ricerca civile calano. La ricerca militare compete con quella civile per gli stessi ricercatori, le stesse infrastrutture, gli stessi talenti in formazione. Come documenta un recente articolo di Nature, la militarizzazione della spesa pubblica sta già ridisegnando le carriere scientifiche: i giovani ricercatori nei campi più appetibili per la difesa si trovano a navigare tra vincoli di riservatezza, limitazioni alla pubblicazione e aspettative di fedeltà istituzionale che mal si conciliano con la scienza aperta. Le disuguaglianze tra paesi sono la conseguenza più preoccupante. I sistemi scientifici dei paesi ad alto reddito possono permettersi di far correre in parallelo ricerca militare e ricerca civile, con budget separati e infrastrutture dedicate. I sistemi più fragili non hanno questa opzione: devono scegliere tra tenere il passo nella corsa alla “sicurezza” o restare irrilevanti nelle aree strategicamente sensibili. L’obiettivo NATO di portare la spesa per la difesa al 5% del PIL prospetta una pressione ancora maggiore. Si configura così una scienza a due velocità: chi corre e chi è lasciato indietro. Nel 2024 i bilanci pubblici per la ricerca calano dell’1,9% nell’area OCSE — mentre la media di intensità dell’investimento R&S si ferma al 2,7% del PIL (l’Italia è penultima con l’1,3%). Chi tira oggi è il mercato della difesa. Non è un caso se Israele guidi la classifica dell’investimento in ricerca e sviluppo con oltre il 6% del PIL. E la società Leonardo già nel 2023 investisse più di 2 miliardi di euro in R&S pari al 12% dell’intera ricerca privata nazionale.

Ognuno gioca a casa sua, o da amici fidati

Fino a non molti anni fa, le collaborazioni scientifiche con altri paesi erano considerate un valore positivo, e la mobilità dei ricercatori veniva considerata un indicatore di salute del sistema. Il quadro è ancora questo? L’OCSE usa il termine “securitizzazione” per descrivere il cambiamento in corso: le politiche della ricerca vengono ridisegnate sempre più in funzione di obiettivi di sicurezza nazionale ed economica, e la domanda che orienta le scelte non è più solo “questa ricerca è utile?” ma «questa ricerca è sicura? chi ne beneficia? rischia di rafforzare un avversario?».

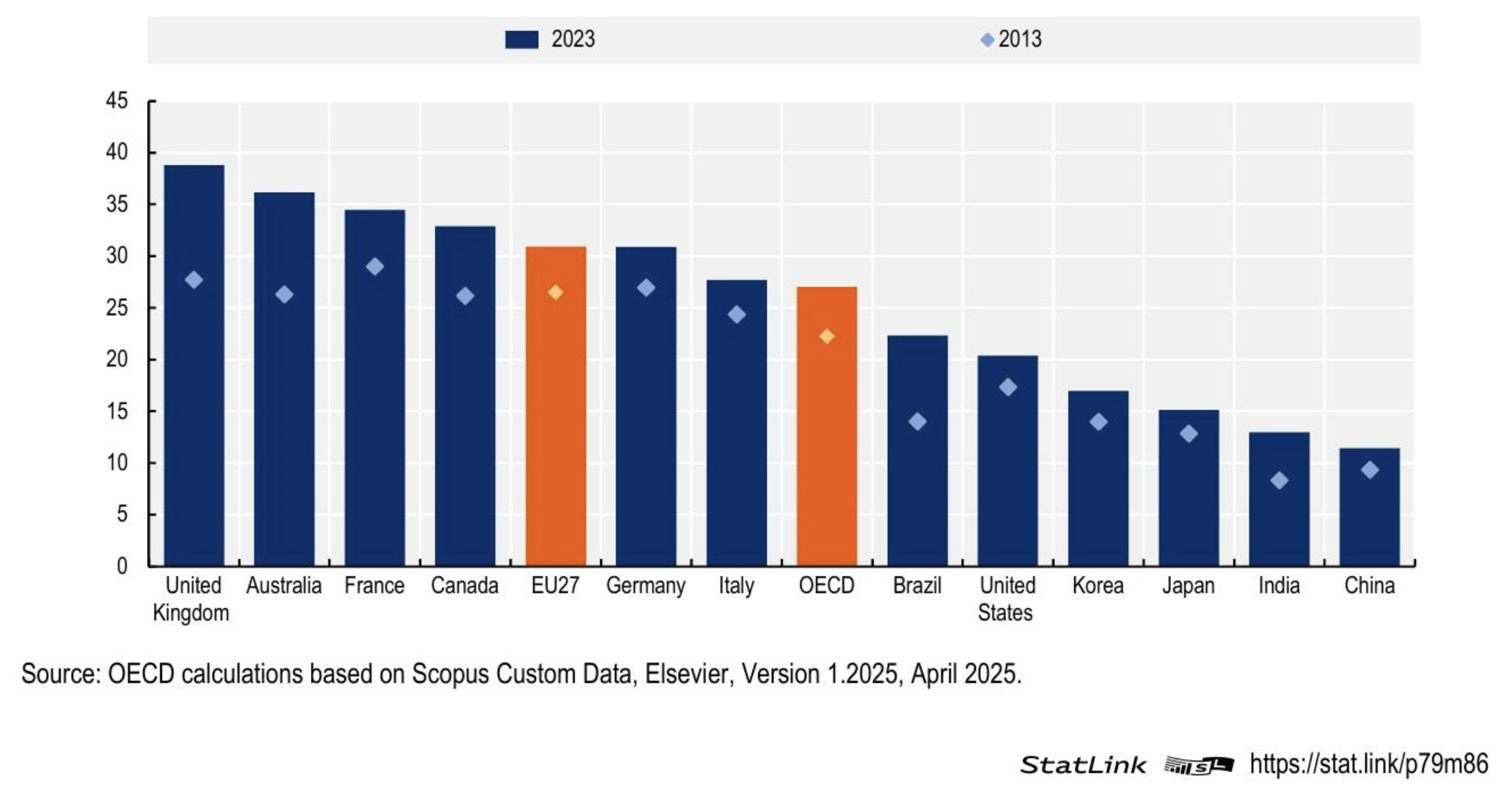

Figura 2 — Intensità della collaborazione scientifica internazionale, paesi selezionati, 2013 e 2023 (% delle pubblicazioni con coautori stranieri). Le barre arancioni indicano EU27 e media OCSE. Fonte: OCSE, elaborazioni su dati Scopus/Elsevier (2025).

Il rapporto identifica tre nuovi filoni attraverso cui viene perseguita la “sicurezza” della ricerca. Il primo è la promozione: i governi investono in modo massiccio nello sviluppo autonomo di tecnologie critiche, non solo per ragioni commerciali ma per evitare dipendenze strategiche. Ne sono esempio il CHIPS Act americano, l’EU Chips Act europeo e i sussidi giapponesi per la produzione di semiconduttori — tutti interventi nati dall’esperienza della crisi delle catene di fornitura durante la pandemia e dall’accelerazione della competizione con la Cina. Il secondo filone è la protezione: difendere la conoscenza rilevante dall’acquisizione da parte di attori stranieri considerati ostili. Questo si traduce in controlli sulle esportazioni di tecnologie dual-use, in screening degli investimenti esteri nelle aziende tecnologiche, in restrizioni alle collaborazioni accademiche con certi paesi e in procedure di sicurezza sempre più invasive per i ricercatori che lavorano in aree strategicamente sensibili. Il terzo filone è la proiezione: usare la scienza come strumento di influenza internazionale, imponendo standard tecnologici, costruendo reti di alleanze scientifiche selettive e orientando la definizione delle regole globali per le tecnologie emergenti, dall’intelligenza artificiale al nucleare civile.

Questo schema è ora esplicitamente adottato dalla maggior parte dei paesi sviluppati. La Strategia di sicurezza economica europea del 2023 è il primo documento in cui l’Unione inquadra formalmente la politica tecnologica in termini di riduzione del rischio strategico. Il rapporto Draghi sulla competitività europea e il rapporto sulla preparazione civile e militare firmato dall’ex presidente finlandese Sauli Niinistö nel 2024 convergono nel chiedere all’Unione di sfruttare meglio il duplice uso civile e militare di tecnologie come l’IA e il quantum computing. Ad aprile 2025 la Commissione europea ha modificato il regolamento dell’European Innovation Council per consentire esplicitamente il finanziamento di tecnologie a potenziale duplice uso. Il decimo Programma Quadro (2028–2034), le cui proposte sono state pubblicate a luglio 2025, adotta per la prima volta un «modello dual-use by design» su larga scala: il budget destinato a ricerca e innovazione dovrebbe raddoppiare a 175 miliardi, ma una quota significativa andrà in sicurezza e difesa. La svolta non è piaciuta a tutti: la League of European Research Universities (LERU) , per esempio, ha protestato, accusando la Commissione di «procedere a testa bassa, senza consultazione né trasparenza». La distinzione tra ricerca civile e militare, in altre parole, si assottiglia.

Il Giappone ha varato il “K Program”: 500 miliardi di yen su dieci anni dedicato a tecnologie critiche in ambito marittimo, aerospaziale e cyber. Gli Stati Uniti hanno rafforzato il Committee on Foreign Investment (CFIUS) e introdotto restrizioni senza precedenti sull’export di chip più evoluti verso la Cina.

Il risultato complessivo è che la scienza, storicamente uno degli spazi più permeabili ai confini nazionali, si trova a dover sceglierei partner in base alle collocazioni geopolitiche. Nel 2023, il 27% delle pubblicazioni scientifiche nei paesi OCSE aveva autori di paesi diversi, contro il 22% del 2013. Ma la crescita si è fermata: il tasso di collaborazione internazionale di Stati Uniti e Unione Europea è sostanzialmente stabile dal 2018. La collaborazione tra Cina e Stati Uniti – per due decenni uno dei motori del progresso scientifico globale – è calata dopo il 2019. E la mobilità dei ricercatori è sotto pressione ovunque.

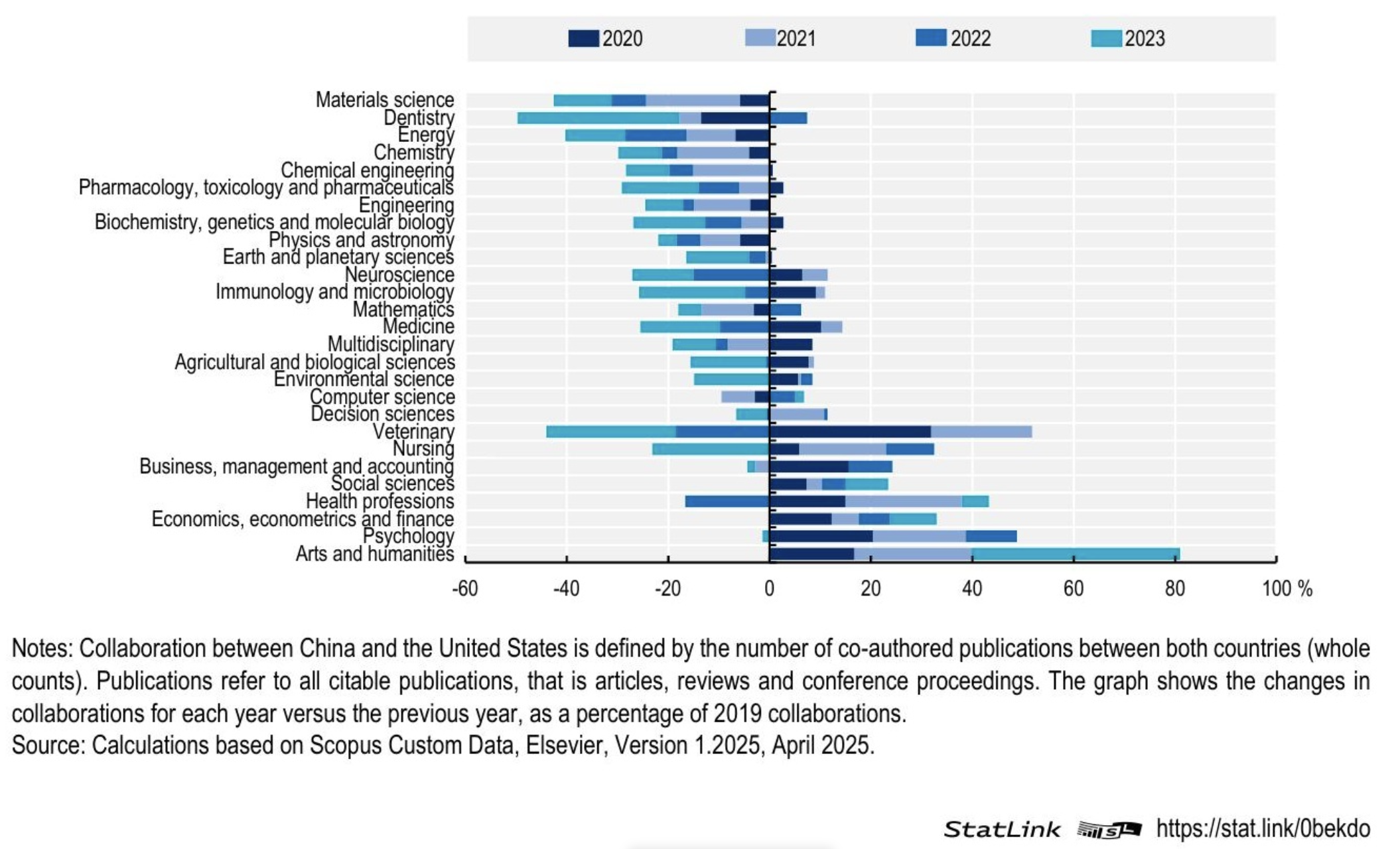

Figura 3 — Variazioni nella collaborazione scientifica tra Cina e Stati Uniti per campo disciplinare, 2019–2023 (variazione % rispetto alla baseline 2019). Il calo è diffuso in quasi tutti i settori, con l’eccezione delle scienze sociali, della psicologia e delle arti. Fonte: OCSE, elaborazioni su dati Scopus/Elsevier (2025).

Il grafico sulla collaborazione Cina-USA mostra bene dove il confine si sta irrigidendo: il calo più netto riguarda scienze dei materiali, chimica, ingegneria e informatica — proprio i campi con il maggiore potenziale applicativo in ambito difesa e sicurezza economica. Le scienze sociali, la psicologia e le arti subiscono restrizioni molto minori, non perché siano meno importanti, ma perché interessano di meno a chi disegna le politiche di sicurezza. Questo crea un effetto collaterale poco discusso: anche la ricerca fondamentale in chimica o fisica dei materiali, che non ha nessuna applicazione militare immediata, finisce per essere guardata con sospetto, rallentata da procedure burocratiche e tagliata fuori da collaborazioni internazionali del tutto legittime.

Nuovo mantra: la convergenza tecnologica

Il quinto capitolo del rapporto è dedicato alla “convergenza tecnologica”: il processo per cui tecnologie un tempo separate si integrano e generano campi del tutto nuovi. Il motore è l’intelligenza artificiale, che funge da connettivo universale, ma l’OCSE individua quattro aree specifiche dove la convergenza produce già risultati concreti e dove la posta in gioco, economica, sociale, geopolitica , è particolarmente alta.

L’OCSE individua quattro aree in cui la convergenza tra discipline produce già risultati concreti — e in cui il confine tra applicazione civile e militare è particolarmente poroso. La biologia sintetica, che combina biologia molecolare, machine learning e automazione, può produrre farmaci su misura ma anche agenti patogeni modificati. Le neurotecnologie aprono nuovi fronti terapeutici per le malattie neurologiche, ma la stessa tecnologia può essere impiegata per sorveglianza cognitiva e potenziamento dei combattenti. Le tecnologie quantistiche sono esplicitamente a doppio uso: la crittografia quantistica ha valore strategico diretto, e i sensori quantistici trovano applicazioni nella navigazione militare e nel rilevamento di sottomarini. L’osservazione terrestre dallo spazio, con microsatelliti a basso costo e algoritmi di visione artificiale, produce strumenti preziosi per il monitoraggio climatico — e altrettanto utili per la sorveglianza militare in tempo reale. Il dual use non è un’eccezione: è la regola. L’OCSE lo riconosce, e il decimo Programma Quadro europeo ne ha fatto un principio esplicito di finanziamento.

Intendiamoci, questo porterà anche a notevoli avanzamenti in diversi campi della ricerca civile, dalla biomedicina al monitoraggio ambientale per rispondere alla, attualmente non molto considerata sfida climatica. La ricerca del futuro andrà governata sia affiancando prospettive disciplinari diverse, sia costruendo filiere che tengano insieme ricerca, sviluppo, formazione e regolamentazione. Gli esempi concreti non mancano. Negli Stati Uniti, il Quantum Institute dell’Argonne National Laboratory vicino a Chicago ha costruito un ecosistema interdisciplinare che integra informatica quantistica, fotonica, comunicazioni, scienza dei materiali e calcolo ad alte prestazioni — un caso di convergenza abilitata da grandi infrastrutture pubbliche che nessun attore privato potrebbe sostenere da solo. Sul fronte delle neurotecnologie, il Wyss Center di Ginevra riunisce neurochirurghi, ingegneri, esperti di AI e di regulatory affairs per produrre terapie che dalla ricerca arrivano al paziente, con un portafoglio che va dalle interfacce cervello-computer alla neuromodulazione guidata dall’IA.

Cosa servirebbe: autonomia, apertura, regolamentazione

Il rapporto su ricerca e sviluppo dell’OCSE spende una parte considerevole del documento a mettere in fila gli antidoti a una deriva autoritaria della ricerca scientifica, per intenderci quella che al momento viene perseguita consapevolmente dalla presidenza statunitense. Vediamoli, questi antidoti.

L’innovazione è importante, ma ha il difetto di essere concentrata in poche mani. Le prime cento aziende per investimenti in R&S coprono da sole il 50% della R&S privata mondiale. I benefici rimangono dove vengono prodotti: nelle regioni più innovative, nei settori ad alta intensità tecnologica, tra i lavoratori con le competenze più avanzate. Il rischio, segnalato con forza dal rapporto, è che le transizioni digitale e verde amplifichino queste disuguaglianze invece di ridurle. La storia offre precedenti poco rassicuranti: durante la Prima rivoluzione industriale i salari reali dei tessitori inglesi si sono dimezzati tra il 1806 e il 1820, mentre la produttività complessiva cresceva. Solo decenni di intervento pubblico hanno portato a una condivisione più ampia dei frutti del cambiamento.

Come ridurre il gap che l’innovazione genera spontaneamente? Il rapporto suggerisce di agire su due livelli distinti di partecipazione. Il primo è l’accesso ai benefici: chi usa le nuove tecnologie, chi trova lavoro di qualità nei settori emergenti. Il secondo, più profondo, è la partecipazione attiva alla produzione dell’innovazione: chi entra nella forza lavoro scientifica, chi siede ai tavoli in cui si definiscono le priorità di ricerca. Su entrambi i fronti il quadro resta insoddisfacente: le donne sono ancora sottorappresentate nei vertici della ricerca e nei consigli degli enti di finanziamento; le regioni periferiche faticano ad attrarre investimenti in R&S; le PMI dei settori a media e bassa intensità tecnologica restano per lo più fuori dal sistema.

La citizen science e la comunicazione scientifica possono fare la differenza: l’OCSE le considera leve per costruire fiducia pubblica nella ricerca e per orientare le domande verso bisogni reali. In parte la Commissione europea ci ha creduto, come dimostra il programma “scienza con e per la società” sviluppato nell’ultimo decennio. Eppure i sistemi di valutazione della ricerca penalizzano ancora chi investe nel dialogo pubblico, anche perché resta difficile dimostrare l’impatto reale di queste politiche in modo misurabile e convincente.

Per contrastare questa progressiva chiusura, l’OCSE propone tre criteri di governo: proporzionalità (calibrare le misure al rischio reale, non applicare restrizioni indiscriminate), precisione (identificare le aree sensibili senza colpire la ricerca in modo generico) e partenariato (coinvolgere la comunità scientifica nella progettazione delle misure, non imporle dall’alto). A questi si aggiungono due imperativi che il rapporto considera non negoziabili: la difesa dell’autonomia e dell’integrità scientifica — la capacità della ricerca di preservare la pubblicazione aperta, la revisione tra pari e la libertà di definire le proprie domande, resistendo alle pressioni che la subordinano a obiettivi politici di breve periodo — e l’investimento nella diplomazia scientifica come strumento attivo per mantenere canali di cooperazione anche tra paesi in tensione, dimostrando che la scienza può essere uno spazio di fiducia reciproca quando la politica tace.

La risposta di Anthropic all’ultimatum di Hegseth dimostra che alcune aziende sono disposte a difendere i propri vincoli etici anche a costo di perdere contratti miliardari. Ma una governance dell’IA militare non può dipendere dalla coscienza individuale dei CEO, peraltro limitata ad alcuni pur rilevanti scrupoli “liberali”. L’OCSE, nei suoi Principi sull’Intelligenza Artificiale aggiornati nel 2024, chiede esplicitamente investimenti pubblici in ricerca affidabile (trustworthy), IA e dataset aperti, sottolineando che la gestione del digitale non può essere lasciata all’autoregolamentazione delle imprese. L’UNESCO ha adottato la prima Raccomandazione globale sull’etica dell’IA, che include il principio di responsabilità umana nell’uso della forza. Ma le istituzioni internazionali si muovono alla velocità della diplomazia, cioè della tartaruga, mentre la tecnologia ha messo il turbo. Ma i tempi non sembrano propizi all’etica dei principi.